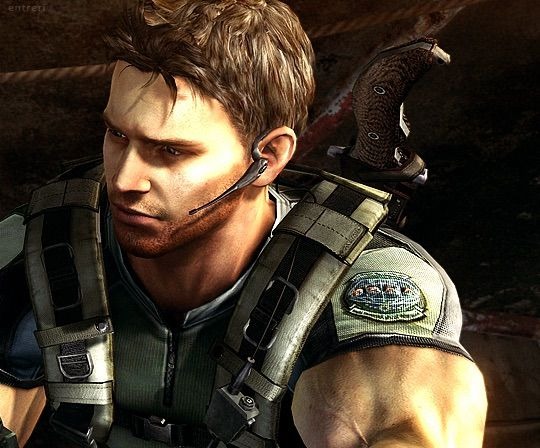

Les jeux en ligne, tels que Call of Duty, sont souvent confrontés aux problèmes de comportements toxiques et agressifs au sein de leur communauté. Pour contrer cela, Activision, l'éditeur de Call of Duty, a décidé de passer à l'action en utilisant les dernières technologies. Dans cet article, nous explorerons comment l'intelligence artificielle (IA) est utilisée pour modérer les chats vocaux et lutter contre les comportements toxiques dans les jeux Call of Duty.

La modération vocale renforcée par l'IA

Activision a récemment introduit un nouvel outil de modération vocale alimenté par l'intelligence artificielle. Cette initiative vise à protéger les joueurs des comportements toxiques et perturbateurs en identifiant et en sanctionnant les mauvais comportements qui n'ont pas été signalés. Grâce à cet outil, appelé ToxMod, Activision espère créer un environnement de jeu plus sain et plus agréable pour tous les joueurs.

Contrairement à une simple détection de mots-clés spécifiques, ToxMod se concentre sur la détection de préjudices et de comportements nuisibles. L'objectif est d'éliminer les discours haineux, sexistes, discriminatoires et autres formes de comportements toxiques dans les chats vocaux de Call of Duty. L'IA sera en mesure de distinguer les échanges amicaux et les taquineries des véritables comportements toxiques.

Comment fonctionne ToxMod ?

ToxMod utilise un modèle linguistique sophistiqué qui a été entraîné à partir de milliers d'heures d'enregistrement de discours divers et variés. Cette IA est capable d'analyser le ton et l'intention du discours pour déterminer s'il est toxique ou non. Cela permet d'éviter les faux positifs et d'assurer une modération équitable.

Lorsqu'un comportement toxique est détecté, ToxMod génère des rapports détaillés sur le type de comportement et son niveau de gravité. Ces rapports sont ensuite transmis à Activision, qui décide des mesures à prendre pour sanctionner les joueurs concernés. Il est important de noter que l'IA n'a pas le pouvoir de bannir directement les joueurs, mais elle facilite le processus de signalement et de prise de décision par les équipes d'Activision.

Les avantages de l'utilisation de l'IA pour la modération vocale

L'utilisation de l'intelligence artificielle pour la modération vocale présente de nombreux avantages. Tout d'abord, cela permet une détection proactive des comportements toxiques, réduisant ainsi la charge de travail des équipes de modération humaines. En détectant automatiquement les comportements toxiques, l'IA peut intervenir rapidement pour prévenir les abus et améliorer l'expérience de jeu pour tous les joueurs.

De plus, l'IA est capable d'analyser le contexte dans lequel les mots sont utilisés, ce qui permet de prendre en compte les nuances et d'éviter les sanctions injustes. Par exemple, l'utilisation d'un mot considéré comme offensant peut parfois être acceptable dans certaines communautés où il est utilisé de manière positive. L'IA tient compte de ces nuances pour évaluer la gravité de l'infraction.

Enfin, l'utilisation de l'IA pour la modération vocale permet de créer un environnement de jeu plus inclusif et respectueux. Les joueurs peuvent se sentir en sécurité, sachant que les comportements toxiques et les discours préjudiciables seront sanctionnés. Cela encourage une communauté plus saine et favorise des interactions positives entre les joueurs.

Déploiement de ToxMod et perspectives futures

Actuellement, ToxMod est en phase de déploiement en Amérique du Nord pour les jeux Call of Duty : Modern Warfare II et Call of Duty : Warzone. Cette phase de test en bêta permettra à Activision de recueillir des retours d'expérience et d'améliorer l'efficacité de l'IA en matière de modération vocale.

Par la suite, ToxMod sera déployé à l'échelle mondiale le 10 novembre, jour de la sortie de Call of Duty : Modern Warfare III. Cette expansion permettra à un plus grand nombre de joueurs de bénéficier de la modération vocale renforcée par l'IA.

Activision espère que cette initiative contribuera à créer une communauté de joueurs plus respectueuse et à améliorer l'expérience de jeu pour tous. Grâce à l'utilisation de l'intelligence artificielle, les comportements toxiques dans les chats vocaux de Call of Duty pourront être réduits, offrant ainsi un environnement de jeu plus agréable et plus sûr pour les joueurs.

Conclusion

La modération vocale alimentée par l'intelligence artificielle représente une avancée majeure dans la lutte contre les comportements toxiques dans les jeux en ligne, tels que Call of Duty. Grâce à l'outil ToxMod, Activision peut détecter et prendre des mesures contre les comportements nuisibles et préjudiciables dans les chats vocaux. Cette initiative contribue à créer un environnement de jeu plus sain, plus respectueux et plus agréable pour tous les joueurs. Avec le déploiement mondial de ToxMod prévu pour novembre, les joueurs de Call of Duty pourront profiter d'une expérience de jeu améliorée, sans les perturbations causées par les comportements toxiques.